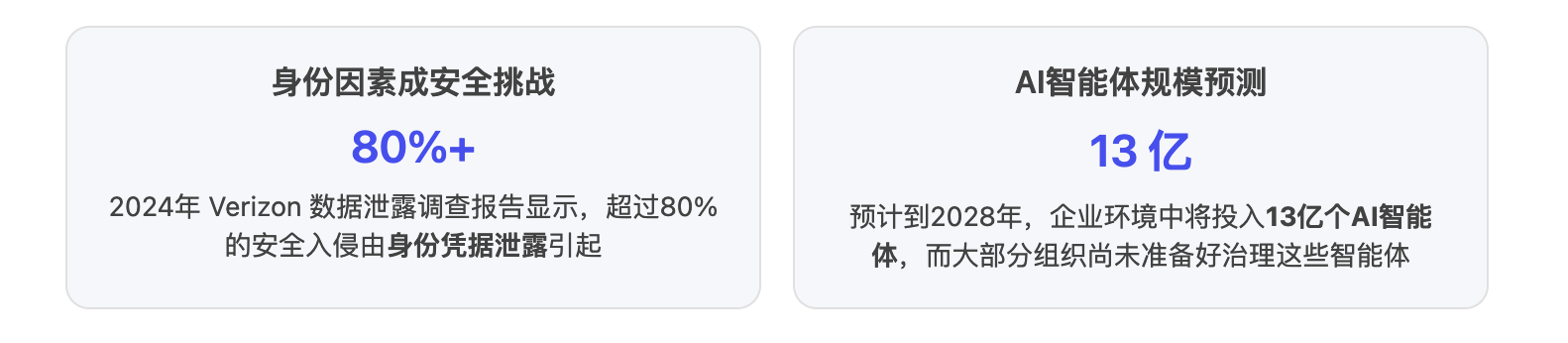

IDC 预计到 2028 年全球将有 13 亿个 AI 智能体投入运营,然而治理能力远未跟上部署速度:微软 Cyber Pulse 报告显示 29% 的企业 AI 智能体在未获 IT 或安全团队批准的情况下运行;独立调查机构 Gravitee 对逾 900 名企业管理层与技术人员的调查更揭示,仅 14.4% 的团队取得完整安全与 IT 审批,88% 的企业在过去一年已遭遇确认或疑似的智能体安全事故。AI 规模化的最大瓶颈不是技术能力,而是信任——如何让每一个 AI 智能体像人类员工一样可控、可观测、可审计?

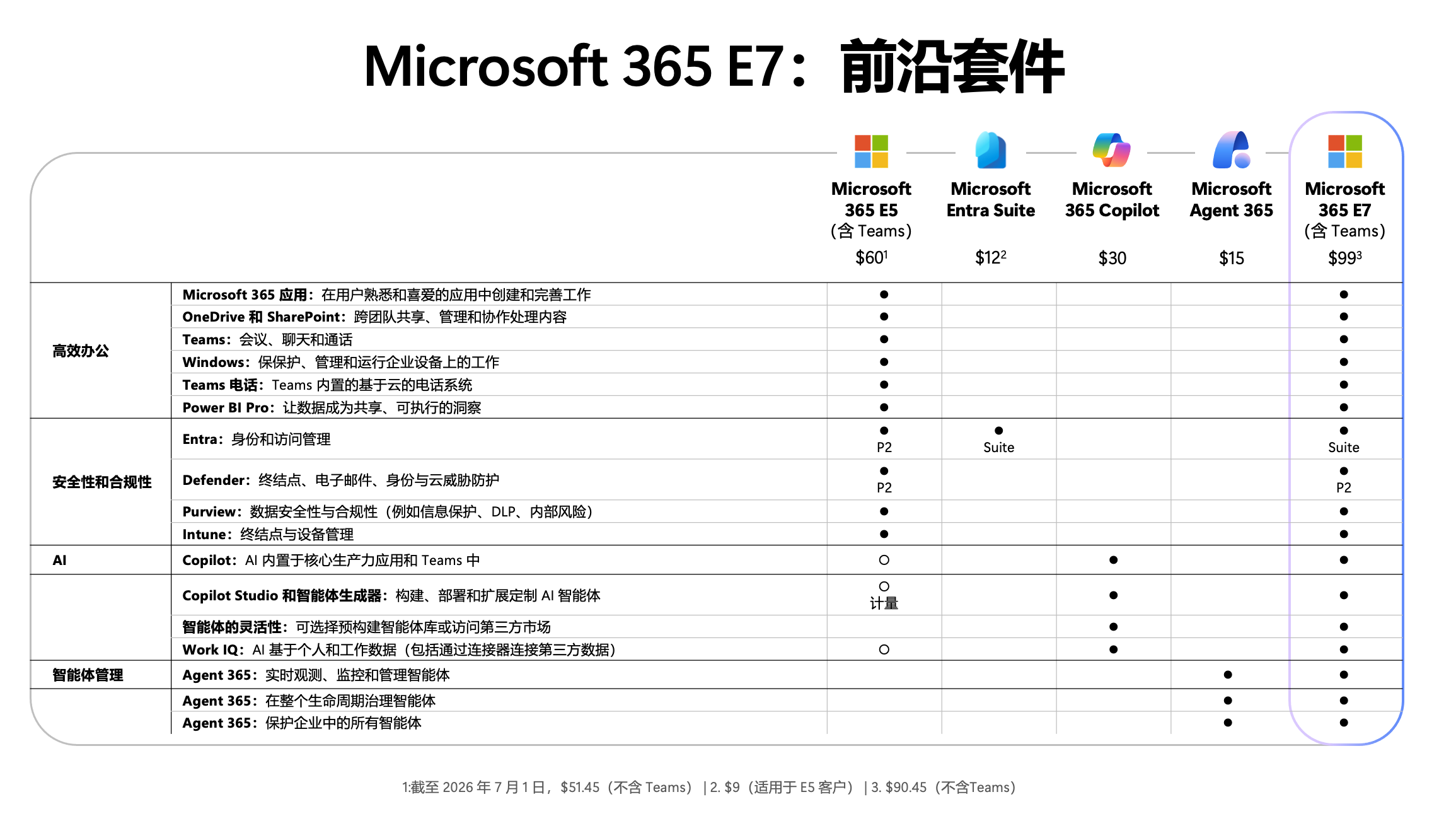

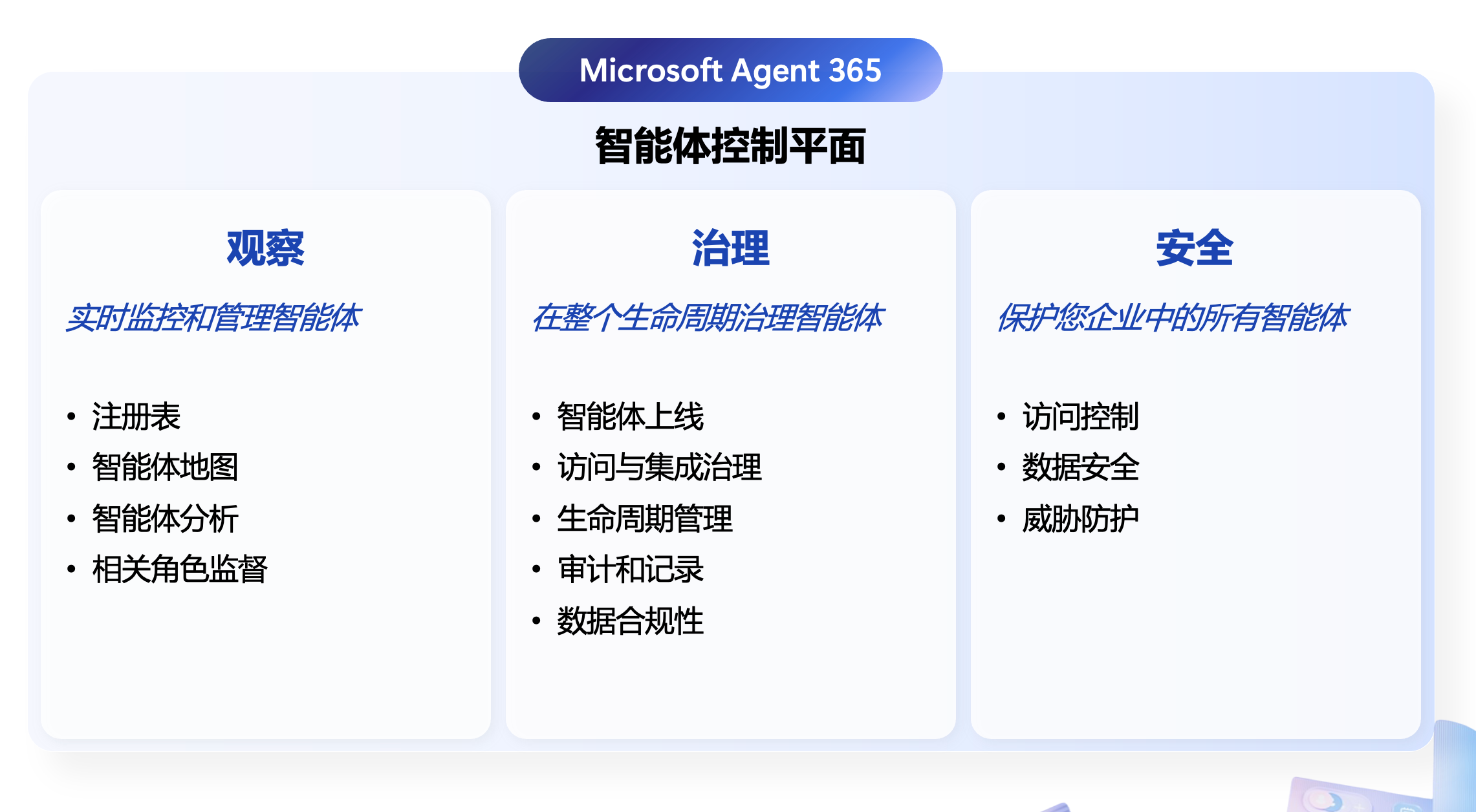

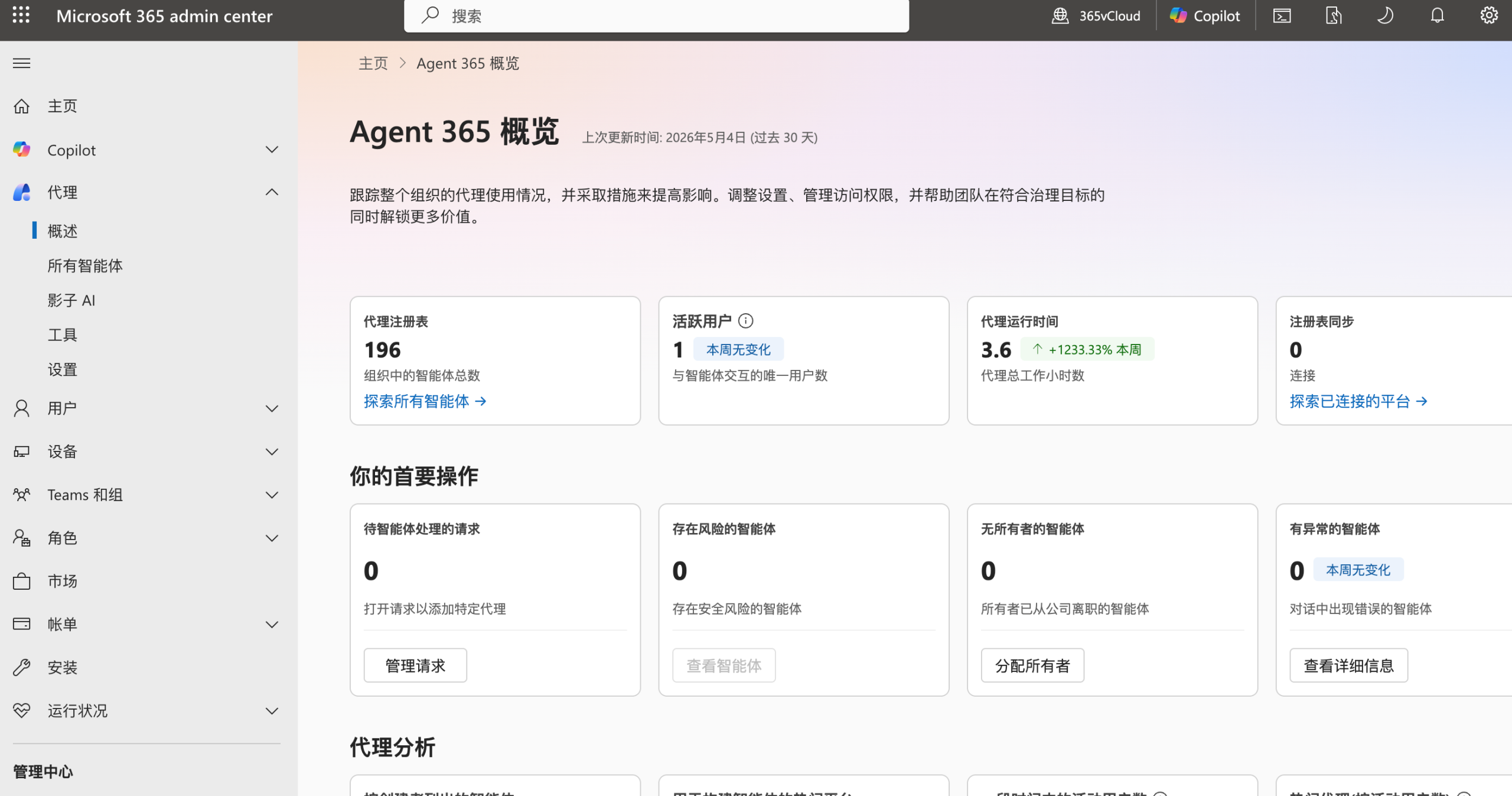

Microsoft 365 E7(又称”Frontier Suite / 前沿套件“)是微软近十年来首个全新的企业级许可版本,于2026年3月9日正式发布、于2026年5月1日全面上市(GA),定价每用户每月99美元(中国区不含音频会议版本为¥726/月)。Microsoft 365 E7 以”身份即新边界”的零信任理念为基石,将 Entra Suite(完整身份治理)、Purview(数据安全边界)、Defender(威胁防护)和全新 Agent 365(智能体治理平台)整合为单一授权方案,为人类用户与 AI 智能体施加一致的安全策略、权限控制与审计追踪。Agent 365 围绕三大支柱构建——可观察性(Observability)、安全(Security)与管治(Governance)——将微软现有安全基础设施延伸至非人类实体:Agent Registry 自动编目企业内所有智能体(无论来源),全新 Agent ID 在 Entra 中为每个智能体建立独立身份并启用条件式访问与最小权限,Purview 确保智能体继承敏感度标签并将内部人员风险监察延伸至智能体行为。

E7 的定位不是简单地在 E5 之上叠加功能,而是以 AI-First(以 AI 为先) 理念重新定义企业工作平台——将 Microsoft 365 E5(生产力+安全+合规基座)、Microsoft 365 Copilot(生成式 AI 助手)、Microsoft Entra Suite(完整零信任身份套件)和 Microsoft Agent 365(AI 智能体治理平台)四大核心组件整合为单一 SKU。对于仍在分别购买 E5($57/月)与 Copilot 附加许可($30/月)的企业,E7 额外纳入了单独采购需 $12/月的完整 Entra Suite 和单独采购需 $15/月的 Agent 365,独立采购四组件合计约 $117/用户/月,E7 捆绑价节省约 $18(约15%)。

本文面向 CIO、CISO 及企业决策层,围绕 E7 平台诠释企业级 AI 转型所需的四大核心维度——AI 战略与治理、典型业务场景、技术落地架构,以及全景式转型路线图。

一、AI 战略与治理:E7 重新定义企业 AI 安全边界

1.1 E7 与 E3/E5 的本质差异

E7 最本质的差异在于:它不再将 AI 视为附加功能,而是将 AI、身份、数据治理和智能体管控一体化纳入平台级架构。 E3/E5 围绕”生产力+安全”设计,AI 能力(Copilot)和高级身份能力(Entra Suite)均需额外付费;E7 则将这些组件与全新的 Agent 365 治理平台融合为统一许可,使企业能在同一个安全框架下同时运行人类员工与 AI 智能体。

| 核心能力 | E3($39/月) | E5($57/月) | E7($99/月) |

|---|---|---|---|

| 生产力应用(Office 桌面/Web/移动端) | ✅ | ✅ | ✅ |

| Exchange、SharePoint、OneDrive、Teams | ✅ | ✅ | ✅ |

| Windows 11 Enterprise | ✅ | ✅ | ✅ |

| Intune 设备管理 | ✅ 基础版 | ✅ 高级版 | ✅ 高级版 |

| Microsoft Defender 安全套件 | 仅 P1 | ✅ 完整 XDR 套件 | ✅ 完整 XDR 套件 |

| Microsoft Purview 合规套件 | 基础 DLP | ✅ 高级(IP、DLP、Insider Risk、eDiscovery、Audit) | ✅ 高级 |

| Power BI Pro | ❌ | ✅ | ✅ |

| Teams Phone | ❌ | ✅ | ✅ |

| Microsoft 365 Copilot | ❌(需 $30/月附加购) | ❌(需 $30/月附加购) | ✅ 内含 |

| Entra Suite 完整版(Internet Access、Private Access | ❌ | 仅 Entra ID P2 | ✅ 完整 Entra Suite |

| Agent 365 智能体治理 | ❌ | ❌ | ✅ 内含 |

数据来源:Microsoft 365 E7 官方页面及社区详细对比

关键决策信息: 对于已运行 E5 + Copilot(合计约 $87-$90/月)的企业,E7 额外新增 Entra Suite(单独 $12/月)与 Agent 365(单独 $15/月),需评估这两项能力是否为当下刚需。E7 的促销优惠有效期至2026年12月,具体折扣如下:

| 促销方案 | 合同期限 | 折扣 | 最低席位 | 最高席位 |

|---|---|---|---|---|

| Microsoft 365 E7 | 年付(1年) | 10% off | 10 | 9,999 |

| Microsoft 365 E7 | 年付(1年) | 15% off | 100 | 9,999 |

| Microsoft 365 E7 | 三年期 | 15% off | 300 | 9,999 |

1.2 数据治理:AI 燃料的安全边界

数据分类与标签 —— E7 中的 Microsoft Purview 信息保护 (MIP) 支持企业自定义多级敏感度标签,将标签自动与 Copilot AI 交互联动。Purview 数据防泄露 (DLP) 策略可扩展到 Copilot 的提示文本:当用户向 Copilot 输入包含信用卡号、身份证号等敏感信息类型(SIT)的提示时,系统在 Copilot 处理之前即对其拦截,不返回任何响应、不执行内部搜索也不进行外部网络搜索。另一类 DLP 策略通过敏感度标签条件限制 Copilot 读取具有特定标签(如”高度机密”)的文件/邮件内容,该项目被引用但内容不会被 AI 读取或摘要。两种策略须使用不同规则,但可置于同一策略中;管理这些策略所需的最低角色为 Purview Data Security AI Admin。策略变更的传播时间最多4小时。

数据最小化与权限感知检索 —— Copilot 通过 Microsoft Graph 语义索引 (Semantic Index) 构建组织级知识地图,使用向量化检索技术在授权范围内返回最相关信息。Copilot 严格执行 Microsoft 365 既有权限和敏感度标签,文件保存至 OneDrive 和 SharePoint 时受租户级控制,当标签不允许提取时,受保护内容不会被 AI 处理。

数据主权与跨境合规 —— 微软已承诺为 15个国家/地区提供 Copilot 交互的本地推理处理(in-country inferencing)。2026年4月更新的时间表显示:澳大利亚、印度、阿联酋、英国和美国预计在2026年底前可用;加拿大将在2027年跟进,日本在2028年跟进。对于欧盟和欧洲自由贸易联盟(EFTA)国家,本地推理按区域级别(而非单一国家)交付,与欧盟数据边界承诺保持一致。此前微软已在27个国家/地区提供 Microsoft 365 和 Copilot 的数据驻留(data residency)服务。微软明确表达其原则为:“你的数据,你的掌控——无论你在哪运营(your data, your control—wherever you operate)”。

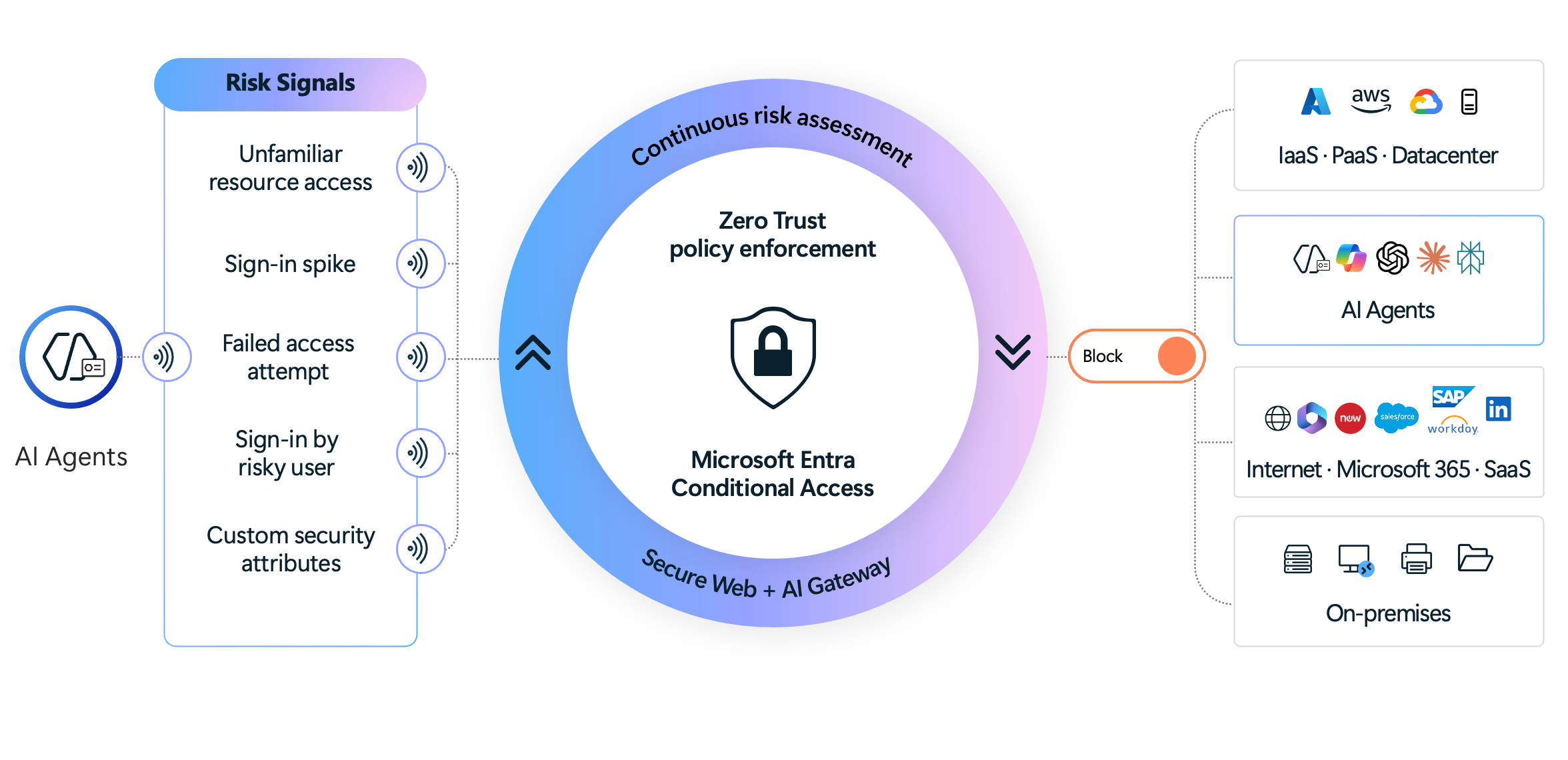

1.3 身份治理:Identity is the New Perimeter

在传统网络边界消亡的今天,身份已成为安全的核心防线。 企业数据分布在多个云与 SaaS 应用中,员工从家庭网络、咖啡馆或酒店 Wi-Fi 连接,合作方使用企业从未触碰过的设备——“内部网络”这一概念已经失去意义。E7 将身份安全置于平台核心,完整 Entra Suite 在 E5 基础上新增了以下关键能力:

| 功能 | E5 包含 | E7 包含(完整 Entra Suite) |

|---|---|---|

| Entra ID P2(条件访问、PIM) | ✅ | ✅ |

| Entra Internet Access | ❌ | ✅ |

| Entra Private Access(ZTNA,VPN 替代方案) | ❌ | ✅ |

| Entra ID Governance(完整版) | ❌ | ✅ |

| Entra Verified ID | ❌ | ✅ |

| 面向智能体的高级条件访问 | ❌ | ✅ |

零信任实践要点:

- 持续访问评估(Continuous Access Evaluation)——认证不再是一次性事件;条件访问策略持续评估设备合规状态、网络位置、用户风险评分、行为异常等信号。当原本正常认证的用户突然在凌晨2点批量下载敏感文件,系统可提升认证要求或终止会话。

- 最小权限与即时提权(Just-in-Time)——PIM 让高权限账号转为按需激活模式,特权仅在执行特定任务时获得、仅持续特定时长,且全程会话录制。当不存在持久性特权凭据时,攻击者的利用难度显著上升。

- 身份治理与访问审查——随着角色变更,权限容易”只增不减”地累积。Entra ID Governance 提供定期访问认证活动(access certification campaigns),要求管理者主动审查并确认下属的权限配置。

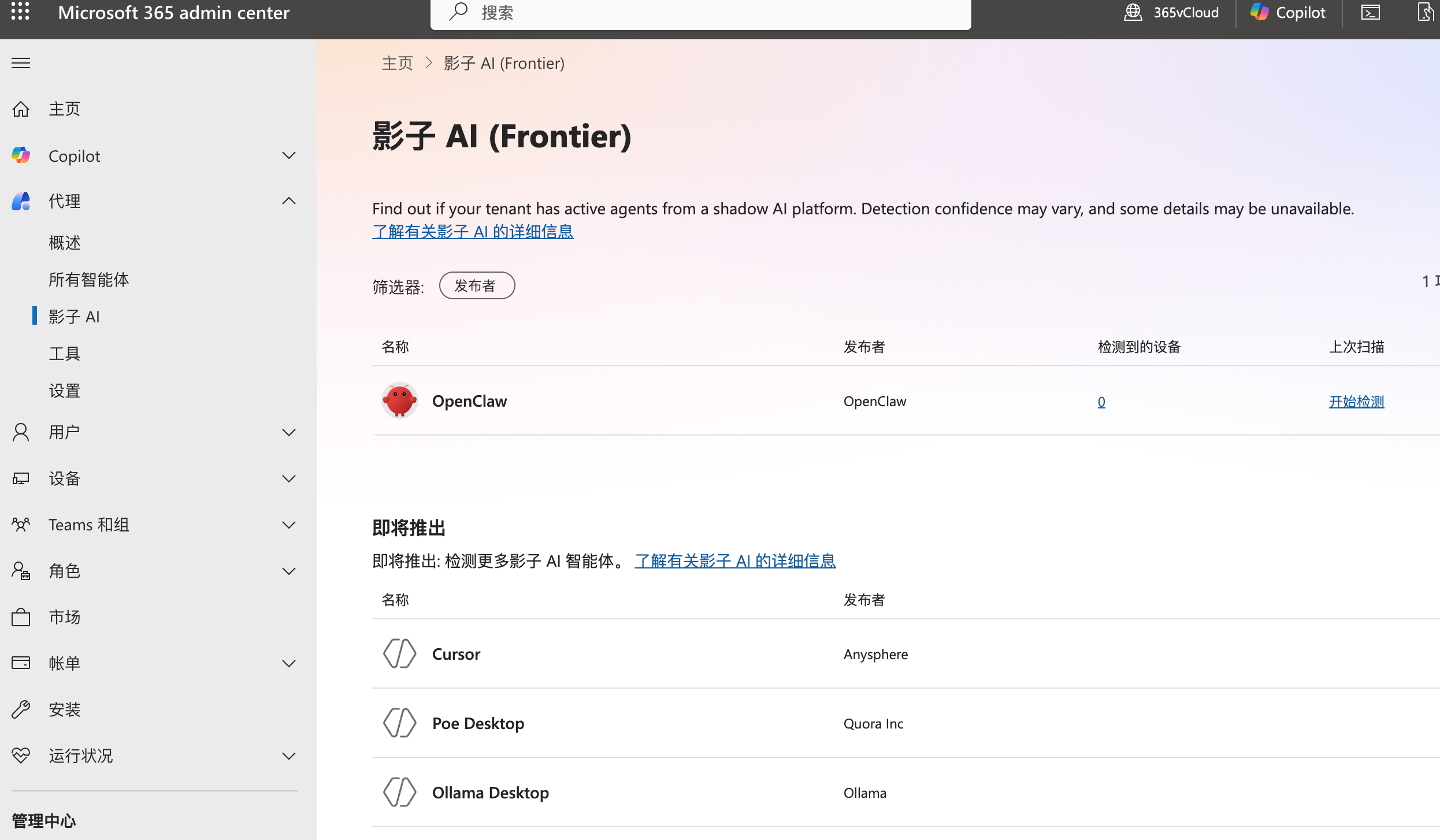

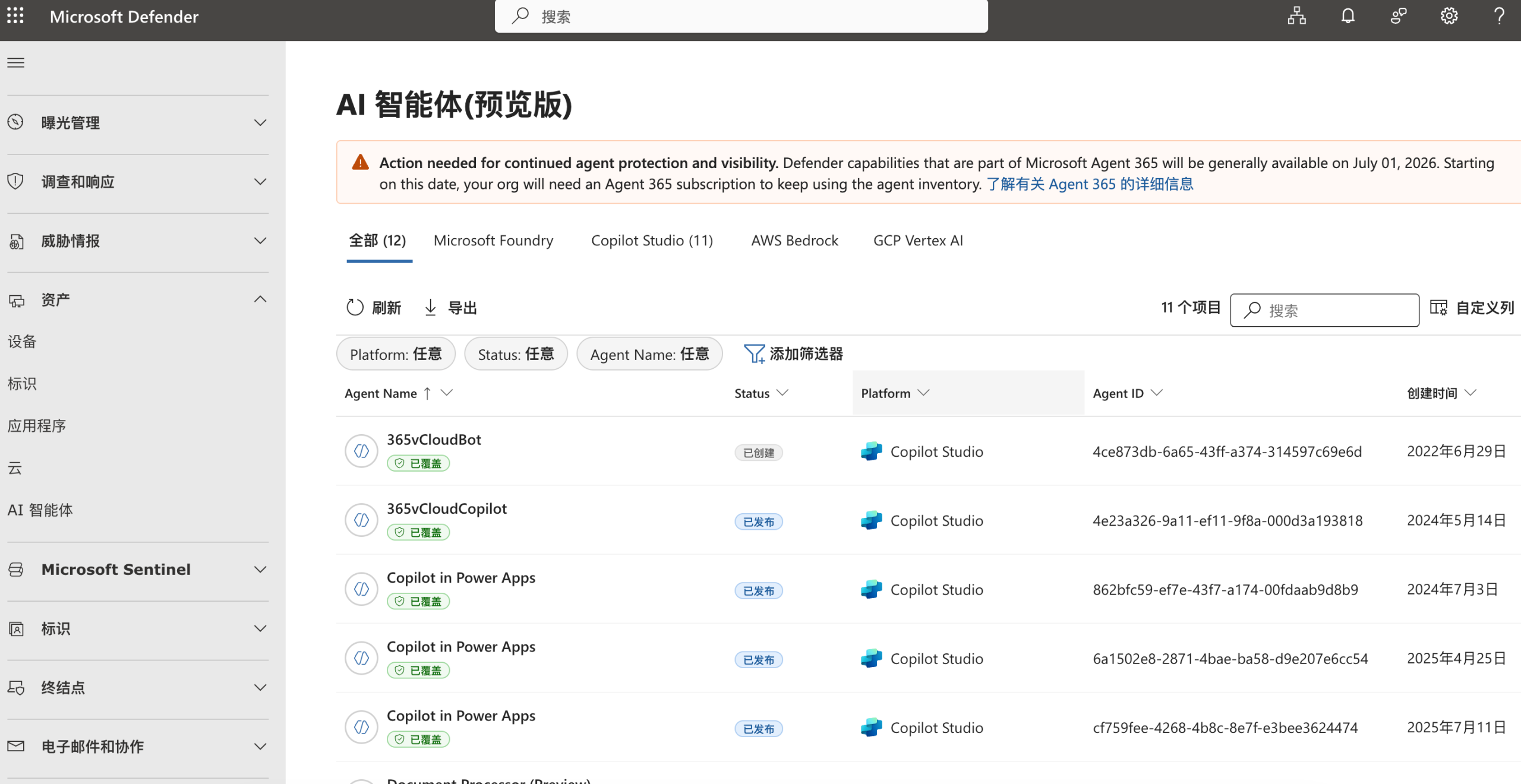

最关键的演进:身份边界扩展至 AI 智能体。 E7 中的 Agent 365 为每个 AI 智能体分配 Entra Agent ID——智能体像员工一样拥有身份、访问策略、审计追踪、生命周期管理和安全控制。企业可以对智能体进行监控、策略管控、暂停或停用,正如管理一个用户账号。这解决了”影子 AI“(Shadow AI)的隐患——那些无主、无审计追踪、无访问控制的智能体在企业环境中悄然运行并访问敏感数据和业务系统。

1.4 合规风险与审计追溯

所有 Copilot 和智能体交互均被纳入 Microsoft 365 审核日志,实现操作可追溯、责任可追查。E7 沿用 E5 的 Purview 合规套件——eDiscovery、审计日志、内部风险管理等——确保安全取证的数据链完整。

Agent 365 还可用于自动化审计:企业可部署合规检查智能体定期扫描权限配置、数据外泄风险与合规策略执行情况,自动整理证据并产出审计所需记录,减少人工反复截图与汇总报表的负担。例如,在金融监管环境中,Agent 可自动检查员工账户是否存在越权访问敏感交易数据等合规违规行为。

权衡提示: 部署速度与治理能力之间存在结构性不对称——构建 AI 智能体的工具免费且易用、无需安全专业知识;而治理智能体的工具需要预算审批、实施周期,以及 IT、安全和业务团队之间的组织协调。Deloitte 的 2026 年企业 AI 报告指出,高层管理者主动参与 AI 治理的企业所获取的商业价值,显著高于将治理工作委派给技术团队的企业。

1.5 负责任 AI:人类在环与可解释性

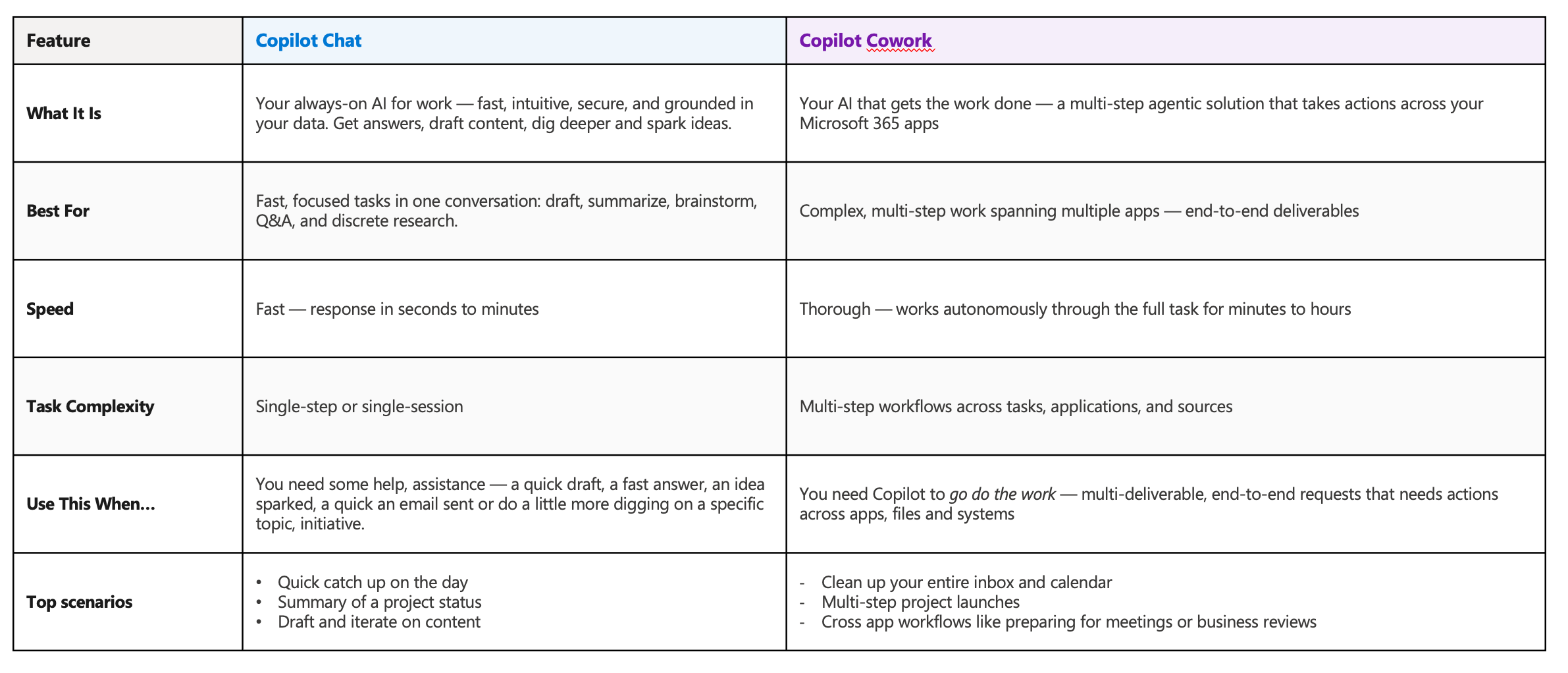

Copilot Cowork 的多步骤执行模式体现了”人类在环”(Human-in-the-loop)原则。当员工要求 Copilot 执行多步骤任务时,系统首先生成一个完整行动计划,用户可在 AI 执行前修改计划,并可以逐步批准每一步操作。任务可持续数分钟或数小时,但进度可查看、方向可调整、执行可随时停止。

可解释性方面,Copilot 在 Word、Outlook 等场景中为 AI 生成的内容附带引用链接,让用户直接查看回答所依据的企业文件或邮件来源。Agent 365 则通过统一注册表(registry)让每个智能体的权限范围、行为日志清晰可知,为 CISO 提供了从提示到输出的完整透明链路。

Copilot Cowork 在技术上结合了 Anthropic 的 Agentic 模型与 Microsoft 365 生态,实现多步任务的托管式企业级体验。所有工作均在 Microsoft 安全、身份和治理框架内运行,文档自动成为受保护的企业知识,可供共享与审计。目前 Copilot Cowork 正以研究预览形式在有限客户群中测试,通过 Frontier Program 获取访问权限。

权衡提示: “人类在环”模式虽保障了可控性,但也意味着高度自治的智能体场景(如7×24无人值守运维)会受到审批流程限制。企业需根据任务风险等级设定不同的审批粒度——高风险决策逐步审批,低风险重复性任务可设定为自动执行并事后审查。

二、典型企业 AI 应用场景

2.1 AI 驱动的现代办公:Copilot in the Flow of Work

Microsoft 365 Copilot 深度嵌入 Word、Excel、PowerPoint、Outlook、Teams 等核心应用,在已有工作界面中完成 AI 交互。Wave 3 将 Copilot 从”对话式助手”推向嵌入式 Agentic 能力,核心场景包括:

- 文档精炼与内容创建:Copilot 在 Word 中不再只是”一次性生成”,而是在文档内持续协作编辑和精炼。它能利用 Work IQ 引擎根据用户工作习惯和组织上下文定制输出内容。所有修改透明、可审阅、可撤销。

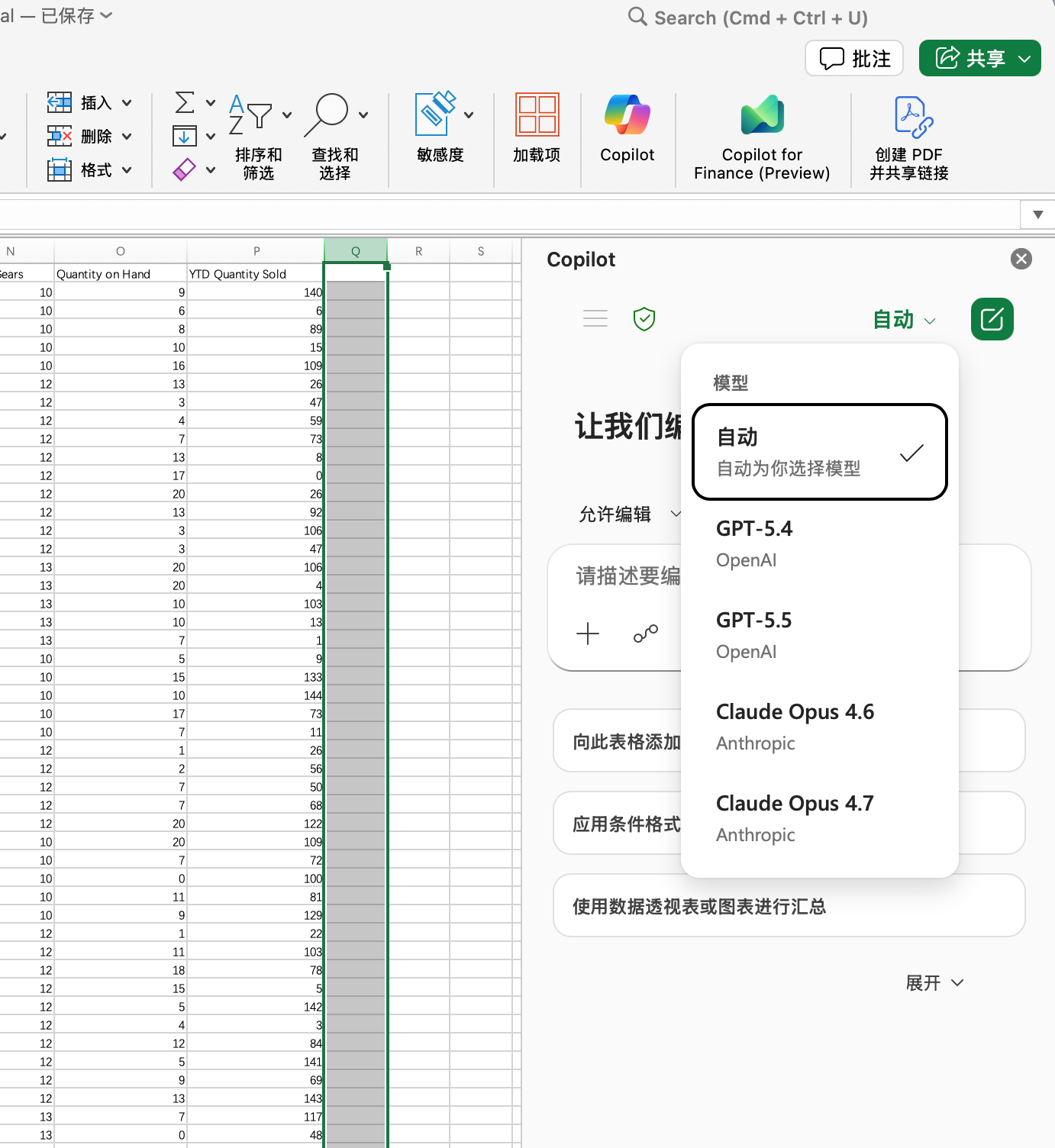

- 数据分析:Copilot 在 Excel 中用真实公式改进电子表格、生成数据透视和可视化图表。

- 演示文稿:PowerPoint 中 Copilot 理解布局、对象样式和品牌工具包,生成符合企业风格的幻灯片。

- 会议与沟通:Teams 中 Copilot 实时总结讨论要点、识别发言人、生成行动项和后续跟进列表。Outlook 中可自动概括重要邮件并草拟专业回复。

- 多模型智能:Wave 3 引入多模型架构——Copilot 自动选择最佳模型(如 OpenAI 或 Claude),用户无需手动切换,企业也避免了单一供应商锁定。

Wave 3 中 Copilot 在 Excel 和 Word 的新体验已全面上市(GA),PowerPoint 和 Outlook 将在未来几个月内陆续推出。

2.2 企业知识管理与智能搜索

Microsoft Graph 语义索引 是 Copilot 知识能力的底层引擎。它汇聚 SharePoint、OneDrive、Exchange 等系统中的信息,通过 AI 构建语义向量索引——理解业务术语和上下文关联,而不仅仅是关键字匹配。

Chat in Copilot 在 Wave 3 中成为聊天优先创建与执行的入口。用户可从对话直接创建文档、电子表格和演示文稿,或请求 Copilot 执行常见操作(如安排会议、起草并发送邮件),无需在多个工具间切换上下文。

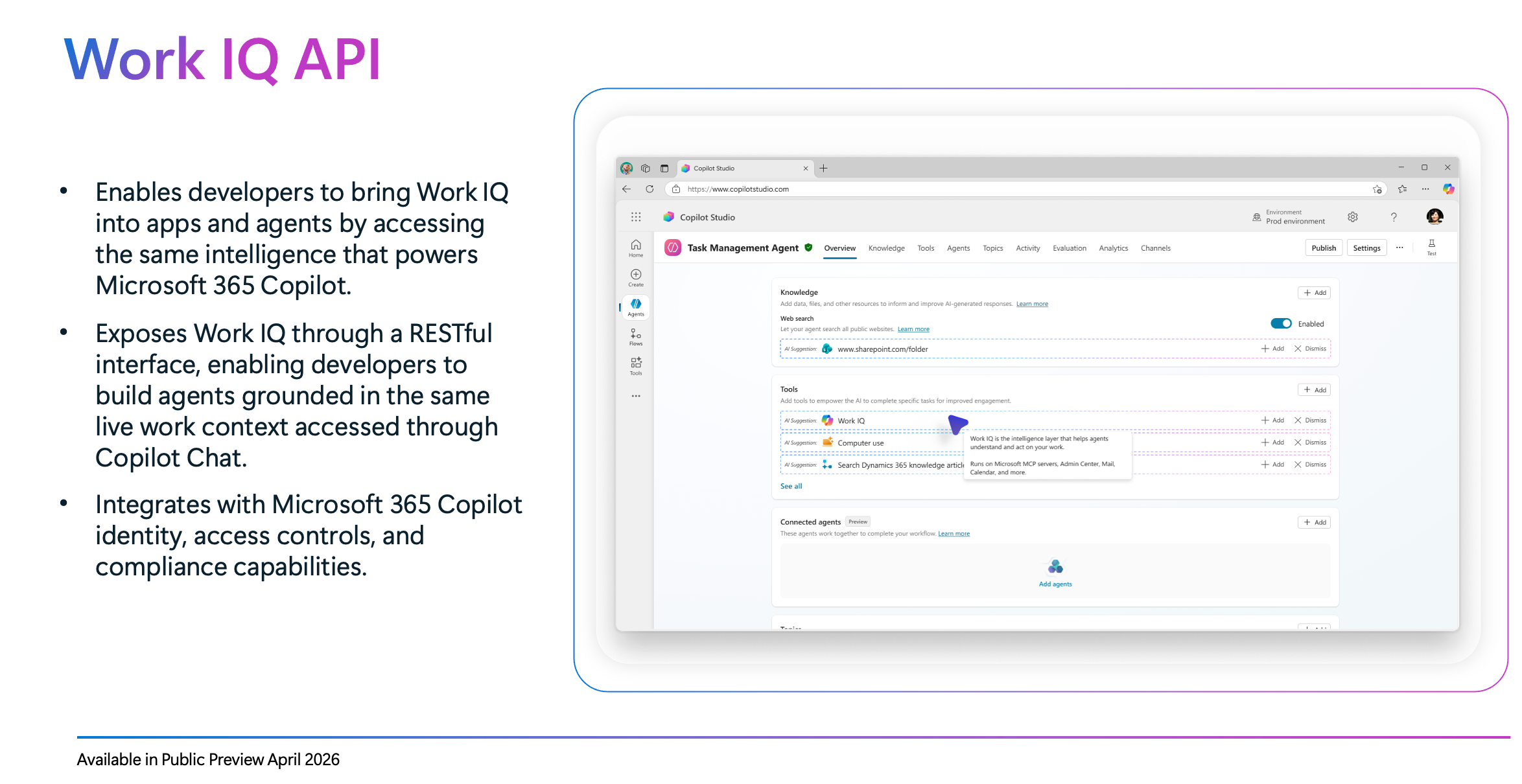

生态扩展:Copilot 支持 Apps SDK 和 MCP Apps 开放标准,合作伙伴应用(如 Adobe、Monday.com、Figma)可直接在 Chat 中呈现实时交互体验。企业还可在Work IQ API(标准 RESTful 接口)上构建自定义智能体,继承 Microsoft 企业级身份认证、安全性、权限和合规性——Microsoft 365 产品营销总经理 Seth Patton 在博客中明确了这一点。

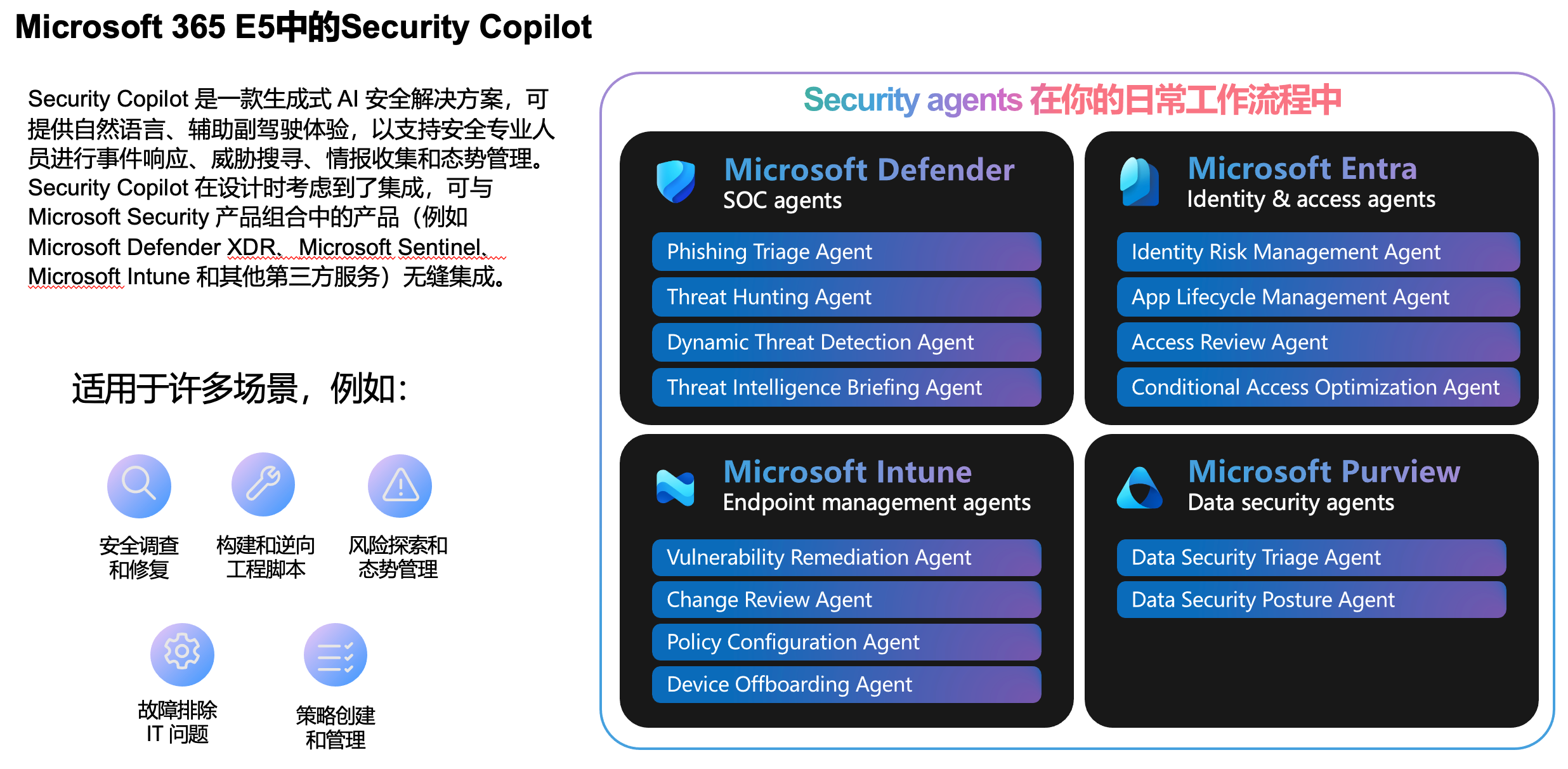

2.3 AI 加持的安全运营(SOC)

Microsoft Security Copilot(独立按使用量付费服务,以安全计算单元 SCU 计费,预计按每小时 $4 费率月结)为安全团队提供生成式 AI 助力。它基于 GPT-4 模型和微软专有安全模型,能处理威胁调查、恶意软件逆向工程、事件报告和引导式响应计划等任务。

实际案例:瑞士 Signode 公司 SOC 经理 Rui Correia 表示,自2025年11月起,团队使用 Security Copilot 协助恶意软件分析、事件响应和告警调查。Correia 比较了有无 Copilot 的调查流程后指出:”Copilot 将每一步的执行速度提升了约 20% 到 50%,因为如果不用 Copilot,你需要登录多个门户并等待任务加载。”微软的研究显示,使用 Security Copilot 的用户完成脚本分析和事件报告等任务的速度平均比不使用 AI 的用户快 22%。

需要注意的权衡:微软的同一研究也发现,对于响应任务,Copilot 实际上使速度降低了约 26%,部分原因是 Copilot 当时需要20多秒才能打开;微软预期产品改进可缩短此延迟。

E7 平台中的 Defender 完整 XDR 套件(Defender for Endpoint、Email、Identity、Cloud Apps)为 SOC 提供跨端点、邮件、身份、云应用的统一威胁检测基础。Security Copilot 作为独立订阅可嵌入 Sentinel、Defender XDR、Purview、Entra 等微软安全产品中,实现多源安全信号的 AI 汇聚分析。

2.4 流程自动化与业务增强

E7 将 AI 驱动的自动化从办公场景扩展至业务流程编排:

-

Copilot + Dynamics 365 / Power Apps:Copilot 被整合到 Dynamics 365(供应链、客服等场景)和 Power Apps(低代码业务应用)中,使 AI 能直接在业务系统界面中访问和整合来自多个平台的信息。例如,管理层可在 Teams 中用自然语言追问“为何本月运营费用上升”,Copilot 融合 ERP、Power BI 数据即时分析并给出解释。

-

Copilot Studio 与自定义 Agent:IT 团队和业务部门通过 Copilot Studio / Agent Builder 构建行业定制智能体,例如财务合规检查 Agent(自动从 ERP 和 Excel 取数,标注异常趋势并生成月度管理报告草稿)、IT/HR 7×24 服务台 Agent(读取内部知识库并自动开工单、更新系统状态,而不只是回答问题)、跨地域调度 Agent(根据不同时区和地区监管规则协调任务、提醒合规要求)。Copilot Studio 近期新增了 Agent Evaluations(公共预览),用真实场景测试智能体的准确性和意图对齐度,在推出前检测因提示、模型或数据变更导致的性能退化。

三、技术落地与参考架构

值得注意的权衡是:部署速度与治理能力之间存在结构性不对称——构建 AI 智能体的工具免费且易用、无需安全专业知识;而治理智能体的工具需要预算审批、实施周期,以及 IT、安全和业务团队之间的组织协调。Gartner 警告,如果企业在治理和投资回报方面的基础工作不到位,超过 40% 的 AI 智能体项目可能在 2027 年前被放弃。Deloitte 的 2026 年企业 AI 报告亦指出,高层管理者主动参与 AI 治理的企业所获取的商业价值,显著高于将治理工作委派给技术团队的企业。E7 提供的不只是工具集,而是让智能与信任共生的企业级治理框架——从实验性 Copilot 到可运营的 Agentic AI,安全不是产品路线图上的待办事项,而是一场与时间的竞赛。

3.1 Entra:AI 时代的身份基础设施

E7 中 Entra 的角色远超传统 IAM——它是人类与 AI 智能体的统一身份控制平面。核心技术要点:

- 统一身份目录:Entra ID 同时管理员工、第三方合作方与 AI 智能体。Entra Agent ID 赋予每个 Agent 独立身份,使其受 Azure AD 同样的认证、授权与审计框架管理。Agent 365 内部培训课程将此描述为”从用户和应用到智能体身份:扩展身份边界(expanding the identity perimeter)“。

- 零信任网络访问(ZTNA):Entra Private Access 替代传统 VPN,Entra Internet Access 提供基于身份的安全 Web 网关——这两项 E5 中不包含的能力在 E7 中内含。当 AI 智能体需要访问内部系统或外部 SaaS 时,流量同样受 Entra 零信任策略评估。

- Agent 365 与 Entra 协同:Agent 365 培训课程明确指出三层操作模型——Observe(发现与清点所有智能体、追踪行为与风险信号)→ Govern(IT 监管下的智能体上线、最小权限、生命周期管理、Purview 日志与合规)→ Secure(将 Defender 威胁防护、Entra 身份控制和 Purview 数据安全扩展至所有智能体,包括第三方智能体)。

3.2 Purview:Copilot 与 Agent 的安全数据边界

Purview 在 E7 架构中承担数据侧护栏角色,具体技术实现包括:

- Prompt 级 DLP:DLP 策略位置选择 “Microsoft 365 Copilot and Copilot Chat”,添加”内容包含 > 敏感信息类型”条件,操作设为“阻止 Copilot 处理内容 > 处理提示”。选择此位置后,同一策略中的其他位置均被禁用。基于文档指纹(document fingerprinting)创建的 SIT 不适用于此类策略,仅支持标准模式和可训练 SIT。

- Web 搜索查询 DLP(公共预览):可阻止包含敏感内容的提示被作为外部 Web 搜索查询发出,但 Copilot 仍可使用组织内部 Microsoft 365 数据回答问题。该能力适用于 Microsoft 365 Copilot 以及在 Copilot Studio 中构建并发布到 Microsoft 365 Copilot 的智能体。

- 标签级保护:通过**”内容包含 > 敏感度标签”条件,阻止 Copilot 读取特定标签文件的正文内容**(文件仍可能出现在引用中)。覆盖范围限于 SharePoint Online 和 OneDrive for Business 中的文件以及 2025年1月1日之后发送的邮件;日历邀请和直接上传到提示中的文件不受扫描。

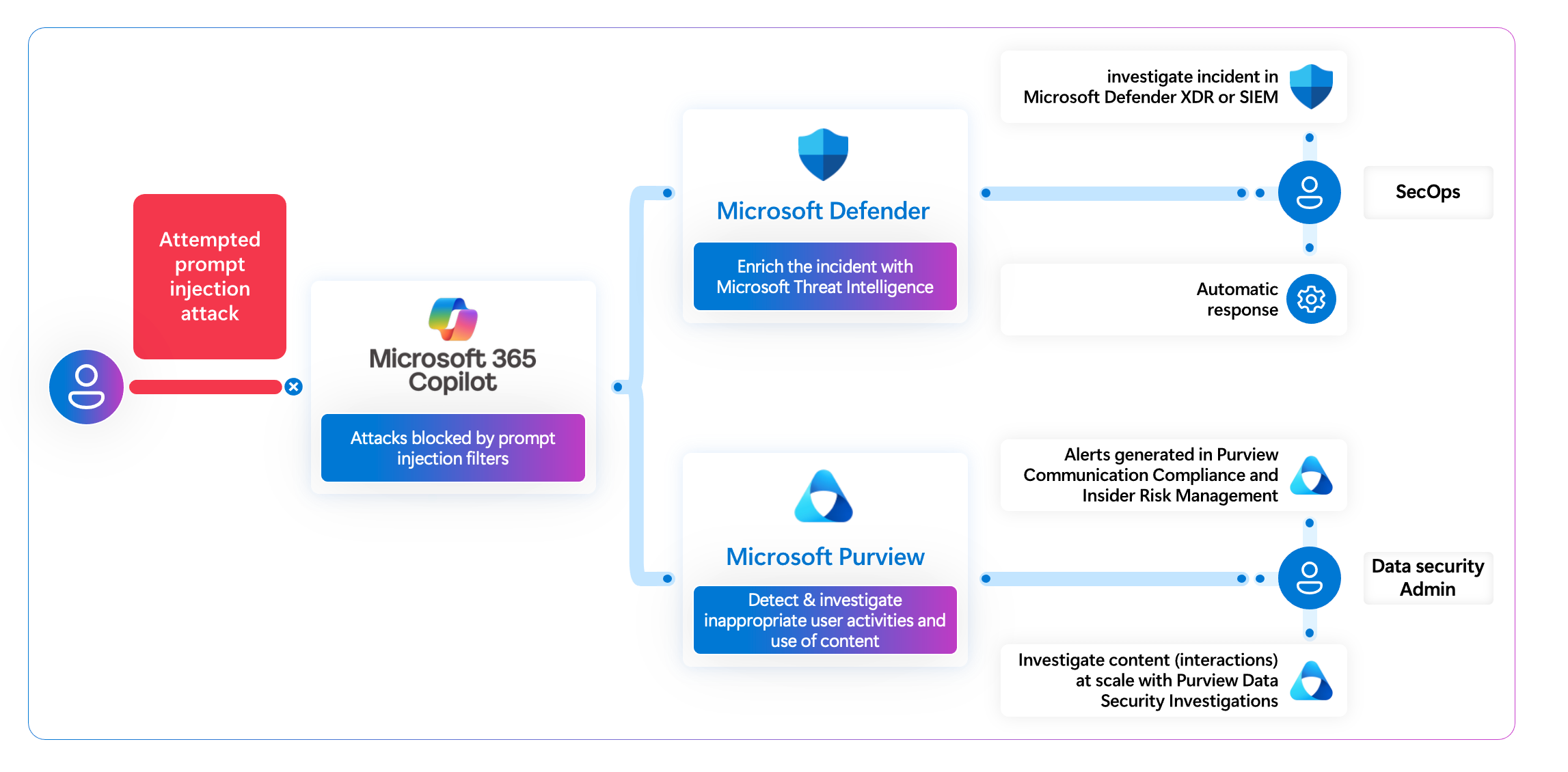

3.3 Defender:XDR 扩展与 AI 安全融合

E7 内含完整 Defender 安全套件(Endpoint、Office 365、Identity、Cloud Apps)。Security Copilot(独立订阅)以两种交付模式接入:独立门户(可与第三方产品集成)和内嵌服务(嵌入 Sentinel、Defender XDR、Purview、Priva 和 Entra 中)。当安全事件发生时,Copilot 基于 GPT-4 和微软专有安全模型,通过编排层、上下文层和应用程序插件处理用户或脚本输入,返回文档摘要、可疑交互标记或安全实践改进建议。

Agent 365 将安全策略统一扩展至所有 AI 智能体——包括第三方智能体——确保反恶意软件 Agent 在获取系统权限时也必须经过 Entra 信任评估,其数据读取同样受 Purview 标签/DLP 管控。这使 CISO 在面对日益扩张的智能体生态时,仍能保持一致的安全基线。

3.4 Copilot 与 Agent 平台:从”可用 AI”到”可控 AI”的架构

检索增强型生成(RAG)架构 —— Copilot 的 LLM 不直接存储客户数据,而是在每次用户提问时通过 Work Graph / Semantic Index 查询组织知识、获取相关片段进行提示强化(Grounding),AI 基于经权限过滤的数据生成回答并附引用。核心数据始终保留在企业自有的 M365 存储中。

Agent 365 作为控制平面 —— 微软 GTM Playbook 将其定位为”Agent 的 Intune“——对所有智能体的集中式注册、治理与安全框架。其在 Microsoft 365 管理中心中与用户并列显示,管理员通过熟悉的管理界面管理 Agent,策略对人类和 AI 一致适用。相较于拼接多个供应商的单点方案(只覆盖治理、或监控、或安全中的某一维度),E7 在单一集成系统中覆盖身份、数据保护、威胁检测和合规。

全栈可观测性 —— E7 官方产品页以”Gain observability across the stack(实现全堆栈可观测性)”作为四大价值主张之一。Agent 365 统一注册表提供智能体运行状况、行为和影响**的实时视图;Defender 与 Purview 提供持续监控告警,将 AI 活动纳入 SOC 监控视野。

四、全景式转型路径:从试点到规模化到治理型 AI

AI 转型是渐进旅程——先安全启动,快速证明价值,在治理和量化评估下扩展。IDC FutureScape 2026 指出,到 2030 年,45% 的组织将在企业级规模化编排 AI 智能体,将其嵌入各业务职能。到 2026 年,40% 的全球 2000 强企业工作岗位将涉及与 AI 智能体协作,重新定义从初级到高级的传统职位。以下按三阶段划分转型路线,并在组织、技术与治理三条主线分别说明重点。

阶段 1:AI 试点探索

| 主线 | 关键动作 |

|---|---|

| 组织 | 成立跨职能试点小组(IT + 业务 + 安全),明确 AI 项目的业务目标与 ROI 指标;从”Copilot Lab”(动手实验室)开始——可选 Copilot Chat、M365 Copilot、Agents、E7 或定制组合 |

| 技术 | 在沙盒环境中部署 Copilot,配置 Graph 语义索引;聚焦2-3个高价值流程(如管理汇报、合规、内部服务台),以6-12周为单位快速产出可量化成果 |

| 治理 | 启用 Purview DLP 监控提示中的敏感数据流动,限制 Copilot 对最高机密数据的访问;在受控环境中验证 DLP 规则执行效果,避免大规模部署隐患 |

CIO 决策重点:确定首批试点场景,量化初始收益;CISO 决策重点:审查安全基线与数据分类状态,确保试点不扩大攻击面。

阶段 2:AI 规模化落地

| 主线 | 关键动作 |

|---|---|

| 组织 | 推进采用与变革管理(Adoption & Change Management),使员工具备 Copilot 使用技能并接受 AI 协作新模式;建立 AI 业务价值量化体系(可参考 Forrester TEI 等外部基准) |

| 技术 | 整合 Copilot Studio + Agent 365,开发行业智能体(财务检查、运营调度等);启用 PIM 和持续访问评估;将 Purview DLP/信息保护与 AI 全面集成;利用 Defender XDR + Security Copilot 提升 SOC 效率 |

| 治理 | 建立 AI 风险评估流程,对新增 AI 场景逐一安全评估;利用 Agent 365 统一注册和监控所有智能体;通过 Observability 仪表盘向管理层汇报 AI 使用成效与风险 |

CIO 决策重点:确定 E7 许可部署范围与时间表,评估促销窗口期(2026年12月前可享折扣);CISO 决策重点:对每个新上线的 Agent 进行身份与权限审查,确保无”影子 AI”盲区。

阶段 3:治理型 AI 成熟

| 主线 | 关键动作 |

|---|---|

| 组织 | 设立 AI 治理委员会或AI 产品经理角色,将 AI 纳入常规运营评估;AI 能力成为员工技能矩阵一部分 |

| 技术 | 持续采纳微软新功能(如多模型支持、Agent Evaluations、Work IQ API 等);通过 Frontier Program 抢先获取最新 AI 创新 |

| 治理 | 建立模型性能与偏差评估机制;动态调整智能体权限和策略以应对业务或法规变化;将安全、合规、AI 使用三项持续监控形成闭环 |

核心理念:E7 不是要一蹴而就地全面上马 AI,而是提供一个可长期演进的平台,让企业在安全合规前提下,逐步将关键流程交给 AI 智能体处理。微软 GTM Playbook 明确指出,随着客户从部署走向日常运营,E7 从”一次性项目”转变为长期管理服务关系——合作伙伴持续管理智能体、优化工作流并不断扩展价值。

五、CISO 未来 90 天安全行动建议

对于正在评估或已启动 E7 / Copilot 部署的 CISO,以下四项行动应在未来 90 天内启动并取得实质进展:

- 全面盘点,消除”影子 AI”盲区:梳理组织当前所有 AI / 智能体应用——扫描代码库、日志与 API 调用记录中的 AI 线索,调查各部门自行启动的 AI 试点项目,核实采购和费用数据以识别未纳管的 SaaS AI 工具,同时建立轻量化的智能体入库流程(intake process),将影子试点转化为受治理的工作负载,为每个智能体指定明确的所有者与用途。

- 将 AI 智能体纳入身份与零信任治理:为关键智能体创建独立身份(如 Entra Agent ID),使其纳入零信任条件访问策略与持续安全监控,并按照最小特权原则严格控制智能体可访问的用户、数据、工具及 MCP 服务器——限制仅访问其所需的资源及其他智能体。将针对用户的条件访问策略和 Internet 流量过滤策略同步扩展至智能体,确保新智能体的上线均须经过由 IT 部门管控的工作流引入并应用安全策略模板。

- 更新数据安全策略,覆盖生成式 AI 场景:启用提示级 DLP(拦截含敏感信息类型的提示)、敏感信息脱敏与标记化处理,并对 AI 输出实施水印和标签措施,防止敏感数据经由 AI 泄露或被模型合成。对检索索引实施版本管理与审批,确保 Copilot 和 Agent 的操作全部记录入审计日志。安全专家建议至少每季度审查一次 AI 数据流和权限配置,并在模型、工具、数据源或使用 AI 的业务流程发生实质性变更时触发重新审批。

- 建立跨部门 AI 治理协同与董事会沟通机制:组建包括安全、IT 与业务代表的 AI 治理工作组,协同监督 AI 部署的风险与收益。将 AI 安全态势纳入董事会/高管层的定期汇报议程,以数据驱动的方式报告 AI 使用现状、风险指标与改进进展。对于 AI 领域而言,高管期望更高、董事会问题更尖锐——CISO 需要以数据而非轶事来回应”AI 是否可控”的核心质询。在 90 天结束时,CISO 应能向管理层提交覆盖全量 AI 资产、风险评级与控制差距的基准报告,明确标注已纳管与未纳管的占比。

面对 AI 从试点走向规模化部署的浪潮,传统安全模式暴露出结构性治理真空。超过 80% 的技术团队已将 AI 智能体投入测试或生产,但仅 14.4% 的上线项目获得完整安全审批;超过一半的企业智能体在无监控、无日志状态下运行。问题的核心在于身份:绝大多数组织仍将智能体视为人类用户的延伸或通用服务账号,缺乏独立的身份认证与授权体系。当智能体之间共享凭据或使用硬编码逻辑时,审计责任链断裂——这正是 Gravitee 报告所指出的”当采用速度超越控制能力“这一结构性危机的根源。E7 通过 Entra Agent ID 让每个智能体成为独立身份主体、以 Purview DLP 在提示与数据层面布设安全护栏、以 Defender XDR 将可观测性与威胁检测扩展至 AI 行为,在单一平台内实现了”可控 AI”与”可审计 AI”的技术条件。

AI 智能体正迅速成为企业的数字员工,信任与治理已上升为董事会关切。领导者当前面对的问题已不再是”要不要用 AI”,而是”我们能否建立对 AI 的掌控与信任”。Gartner 基于逾 3,400 家组织的调查预测,缺乏战略清晰度与治理能力的 Agentic AI 项目中,超过 40% 将在 2027 年底前被取消;IDC FutureScape 2026 预测,到 2030 年,多达 20% 的全球千强企业将因 AI 智能体管控不力而遭遇法律诉讼、巨额罚款甚至 CIO 问责。可控、可审计的 AI 已不仅是技术课题,更是企业风险管理与战略转型的关键议题。Microsoft 365 E7 以 Intelligence + Trust(智能与信任) 为架构双核,通过统一身份、数据和安全治理,让企业在尽享 AI 生产力红利的同时始终牢握主动权。现在,真正的竞争优势不是谁先部署了 AI,而是谁先建立了治理 AI 的能力。